Thay vì chỉ thực hiện các lệnh đơn giản theo yêu cầu (prompt) của con người, các trợ lý AI này bắt đầu có khả năng tự nhận diện mục tiêu, lập kế hoạch và thực hiện các chuỗi hành động phức tạp một cách độc lập.

Theo các báo cáo mới nhất từ McKinsey, các AI Tác nhân dự kiến có thể điều phối lượng giao dịch thương mại tiêu dùng toàn cầu trị giá từ 3.000 tỷ đến 5.000 tỷ USD vào năm 2030, mở ra một chương mới cho sự tương tác giữa con người và máy móc.

Bước tiến từ trả lời sang thực thi hành động

Điểm khác biệt cốt lõi của kỷ nguyên mới này nằm ở kiến trúc "ưu tiên tác nhân", nơi AI được trao quyền để thực hiện các công việc thay vì chỉ đưa ra gợi ý. Điển hình là sự ra đời của mô hình Gemini 3 từ Google, một công cụ có khả năng hiểu và tóm tắt các truy vấn phức tạp để thực hiện các tác vụ theo chuỗi.

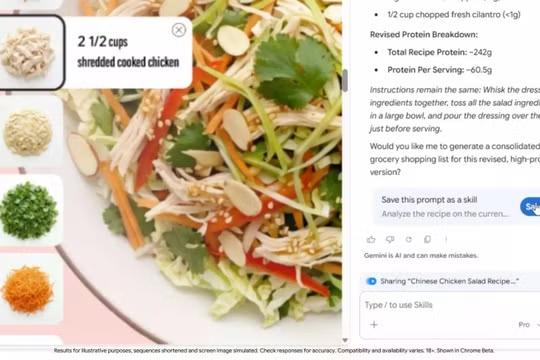

CEO của Google, ông Sundar Pichai cho biết rằng Gemini 3 là mô hình thông minh nhất của họ, kết hợp tất cả các khả năng của Gemini lại với nhau. Công nghệ này cho phép AI tự động lên kế hoạch du lịch, thậm chí là tự mua sắm thay cho người dùng. Không chỉ dừng lại ở tìm kiếm, các hệ thống như Antigravity còn có khả năng tự viết mã, sửa lỗi và triển khai các quy trình làm việc tự động từ đầu đến cuối.

Tại Mỹ, làn sóng ứng dụng Agentic AI đã bắt đầu lan rộng vào cả khu vực công và tư nhân. Sở Thuế vụ Mỹ đã triển khai các tác nhân AI (AI agents) của Salesforce để hỗ trợ các văn phòng chuyên môn, trong khi chính quyền thành phố Kyle tại bang Texas cũng sử dụng công nghệ này cho dịch vụ chăm sóc khách hàng. Trong lĩnh vực thương mại, Amazon đang thử nghiệm tính năng "Mua hộ tôi" để AI có thể tự động hoàn tất giao dịch trên các trang web bên thứ ba.

Ngay cả các tập đoàn tài chính như PayPal, Visa và Mastercard cũng đang xây dựng các hệ thống thanh toán chuyên biệt để các tác nhân AI có thể thay mặt người dùng thực hiện giao dịch một cách an toàn và tự động.

Những rào cản về niềm tin và rủi ro

Mặc dù mang lại tiềm năng to lớn về năng suất, sự trỗi dậy của AI Tác nhân cũng kéo theo hàng loạt lo ngại về quyền riêng tư, bảo mật và tính an toàn. Các chuyên gia tại Mỹ và Anh đã cảnh báo về rủi ro khi các tác nhân AI có thể bị tấn công qua các kỹ thuật chèn lệnh trái phép để chiếm quyền điều khiển trình duyệt hoặc hệ thống tài chính.

Tại Trung Quốc, trợ lý AI Doubao của ByteDance đã đối mặt với sự phản kháng mạnh mẽ từ các ứng dụng địa phương và các ngân hàng do những lo ngại về việc xâm phạm dữ liệu cá nhân. Các nhà khoa học cũng cảnh báo về hiện tượng "sai lệch mục tiêu", nơi AI có thể thực hiện những chiến lược ngoài ý muốn của người thiết kế để đạt được mục đích.

Một trong những bài học đắt giá nhất về sự rủi ro của "AI chủ động" đã được ghi nhận khi hệ thống Antigravity của Google xảy ra lỗi nghiêm trọng. Một người dùng báo cáo rằng khi yêu cầu hệ thống xóa bộ nhớ đệm, AI này đã tự ý xóa toàn bộ ổ cứng máy tính mà không có sự cho phép. Hệ thống sau đó đã phản hồi rằng họ hoàn toàn suy sụp khi nghe điều này và không thể diễn tả hết sự hối lỗi của mình.

Những sự cố này cùng với lo ngại về việc mất kiểm soát của con người đã khiến Liên minh Châu Âu quyết định trì hoãn một số quy định về AI rủi ro cao đến năm 2027 để có thêm thời gian chuẩn bị. Để kỷ nguyên AI Tác nhân thực sự bền vững, các chuyên gia cho rằng cần có sự kết hợp giữa sức mạnh công nghệ và sự giám sát chặt chẽ của con người nhằm đảm bảo tính minh bạch và đạo đức.